شهد العالم في العقود الأخيرة تطورًا تكنولوجيًا مذهلًا أحدث نقلة نوعية في جميع جوانب الحياة، إذ باتت التكنولوجيا بمثابة القوة المحركة للعصر الرقمي، حيث تجاوزت مجرد كونها أدوات مساعدة لتصبح عنصرًا أساسيًا يعيد تشكيل المجتمعات والاقتصادات وحتى الثقافات، ومن بين أبرز إنجازات هذا التقدم التكنولوجي، يبرز الذكاء الاصطناعي كواحد من أكثر الابتكارات تأثيرًا وإثارة للجدل.

فلم يعد محصورًا في المختبرات البحثية أو التطبيقات الصناعية، بل أصبح جزءًا لا يتجزأ من حياتنا اليومية، فقد تم توظيفه في وسائل الإعلام الرقمية لتحليل البيانات، وتخصيص المحتوى، والتفاعل مع الجمهور، إلا أنه على الرغم من هذه التطورات، ظهرت تحديات أخلاقية عميقة تتطلب اهتمامًا جادًا، مثل قضايا الشفافية والخصوصية والتحيز الخوارزمي، ومدى تأثير هذه التقنيات على الثقة العامة بالمعلومات التي يتم تداولها.

وفي سياق تطور تقنيات الذكاء الاصطناعي في مجال الإعلام الرقمي، تتعاظم أهمية الأخلاقيات مع الانتشار المتزايد للذكاء الاصطناعي، فبينما تسهم هذه التقنية في تحسين كفاءة عمليات الإنتاج الإعلامي وتوسيع نطاق التفاعل مع الجمهور، فإنها تثير أسئلة أخلاقية معقدة حول كيفية استخدام هذه الأدوات بشكل مسؤول، فالأخلاقيات الإعلامية الرقمية أصبحت بذلك ليست خيارًا، بل ضرورة لضمان أن تسهم التقنيات الحديثة في تعزيز القيم الإيجابية بدلًا من أن تكون وسيلة للإضرار بالمجتمع أو التلاعب به.

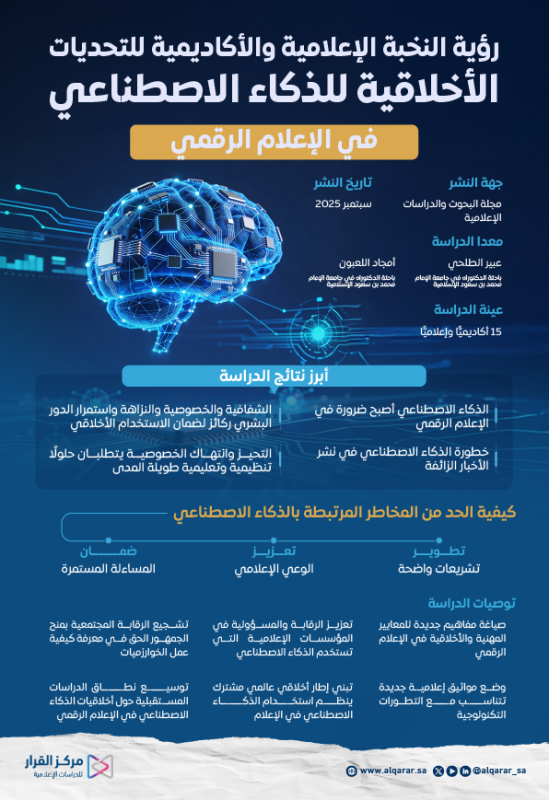

وفي هذا الإطار، نشرت مجلة البحوث والدراسات الإعلامية في عددها الصادر في سبتمبر 2025، دراسة بعنوان “رؤية النخبة الإعلامية والأكاديمية نحو التحديات الأخلاقية للذكاء الاصطناعي في الإعلام الرقمي (دراسة استشرافية خلال العقد 2024-2034م)” من إعداد عبير بنت عبد ربه الطلحي باحثة الدكتوراه بقسم الصحافة والإعلام الجديد في جامعة الإمام محمد بن سعود الإسلامية، وأمجاد بنت محمد اللعبون باحثة الدكتوراه في الجامعة ذاتها بقسم العلاقات العامة والاتصال التسويقي، وقد اعتمدت الدراسة على منهج دلفي من خلال مجموعة مناقشة مفتوحة ضمت 15 مشاركاً من الأكاديميين والممارسين الإعلاميين، والتي نستعرضها على النحو التالي:

- نتائج الدراسة

أشارت نتائج الدراسة إلى أن هناك صعوبة في تحديد المسؤوليات الأخلاقية للذكاء الاصطناعي في الصحافة، وأن غياب الشفافية والمساءلة القانونية من أبرز التحديات. وسلطت الضوء على خطورة الذكاء الاصطناعي في نشر الأخبار الزائفة، وأن هناك حاجة ملحة لوضع آليات قانونية وتقنية لمكافحتها.

وخلصت الدراسة إلى أن مستقبل الذكاء الاصطناعي في الإعلام يحمل سيناريوهات متباينة ما بين التفاؤلي (الإصلاحي) والتشاؤمي (الانهيار)، ما يعكس حالة عدم اليقين في تبني هذه التقنيات بشكل آمن وأخلاقي.

وأظهرت نتائج الدراسة بعد تحليل متعمق لآراء المشاركين، أنه يمكن استخلاص أربع نقاط توافق أساسية:

- الذكاء الاصطناعي أصبح ضرورة في الإعلام الرقمي، لكن لا بد من وضع ضوابط صارمة تحكم استخدامه.

- الشفافية والخصوصية والنزاهة واستمرار الدور البشري هي ركائز أساسية لضمان استخدام أخلاقي للذكاء الاصطناعي.

- التحديات الأخلاقية مثل التحيز وانتهاك الخصوصية تتطلب حلولًا تنظيمية وتعليمية طويلة المدى.

- يمكن الحد من المخاطر المرتبطة بالذكاء الاصطناعي من خلال تطوير تشريعات واضحة، وتعزيز الوعي الإعلامي، وضمان المساءلة المستمرة.

كما أن هناك إجماعًا واسعًا على أهمية القيم الأخلاقية في استخدام الذكاء الاصطناعي بالإعلام، وهو مؤشر على ضرورة تطوير سياسات واضحة، وهو ما يتطلب تعاونًا بين الحكومات والمؤسسات الإعلامية، والخبراء التقنيين لضمان الاستخدام المسؤول للذكاء الاصطناعي.

وتشير الدراسة أيضًا إلى أن المستقبل يتطلب إطارًا رقابيًا واضحًا، وتعزيز الشفافية، وتمكين الصحفيين من العمل جنبًا إلى جنب مع الذكاء الاصطناعي بدلًا من استبدالهم، ورغم أن التحديات قد تبقى مستمرة، فإن وضع سياسات مدروسة يمكن أن يحد من آثارها السلبية.

- توصيات الدراسة

قدمت الدراسة عددًا من التوصيات تمثلت فيما يلي:

- صياغة مفاهيم جديدة للمعايير المهنية والأخلاقية والمسؤولية الاجتماعية في الإعلام الرقمي، مثل إنشاء مفاهيم جديدة مثل “حارس البوابة الخوارزمي” بحيث يتم تصميم الخوارزميات لتراعي أخلاقيات الإعلام والمصلحة العامة بدلاً من تحقيق أقصى قدر من التفاعل فقط.

- تعزيز الرقابة والمسؤولية في المؤسسات والمنظمات الإعلامية التي تستخدم الذكاء الاصطناعي، وذلك من خلال إلزام المؤسسات الإعلامية بإجراء تدقيق دوري على الخوارزميات المستخدمة لضمان عدم التحيز أو التضليل الإعلامي.

- تشجيع الرقابة المجتمعية من خلال منح الجمهور الحق في معرفة كيفية عمل الخوارزميات، وتأثيرها على المحتوى الإعلامي.

- وضع مواثيق إعلامية جديدة تتناسب مع التطورات التكنولوجية من خلال تحديث مواثيق الشرف الإعلامية التقليدية، لتشمل بنودًا خاصة باستخدام الذكاء الاصطناعي، مثل المسؤولية عن الأخبار الزائفة والمحتوى المضلل الناتج عن الأنظمة الذكية.

- تبني إطار أخلاقي عالمي مشترك ينظم استخدام الذكاء الاصطناعي في الإعلام، خاصة في ظل الطبيعة العابرة للحدود للمنصات الرقمية.

- توسيع نطاق الدراسات المستقبلية حول أخلاقيات الذكاء الاصطناعي في الإعلام الرقمي من خلال دعم البحوث الكيفية والاستشرافية لفهم التأثيرات المستقبلية لاستخدام الذكاء الاصطناعي على القيم الإعلامية والمهنية.